Az MI talán már nem sci-fi, hanem a bérszámfejtő kollégája

2026 elejére a mesterséges intelligencia (MI) végérvényesen kilépett a technológiai szektor buborékából, és a mindennapi vállalati működés szerves részévé vált. A bérszámfejtés és a humán erőforrás menedzsment (HR) területén az automatizáció már nem csupán lehetőség, hanem versenyelőny – sőt, bizonyos létszám felett talán már kényszer is.

Ugyanakkor szakemberként kötelességem felhívni a figyelmet: az algoritmusok térnyerése nem mentesíti a munkáltatót a Munka Törvénykönyve (Mt.) és az általános adatvédelmi rendelet (GDPR) betartása alól.

Jelen cikkben azt vizsgáljuk meg, hogyan illeszthető be az MI a munkaügyi folyamatokba úgy, hogy az jogilag tiszta, etikailag vállalható és szakmailag precíz maradjon.

Mielőtt bármilyen konkrétumra hívnám fel az olvasó véleményét, vizsgáljuk meg a hátterét mindennek. Mert engem így tanítottak.

Született egy rendelet

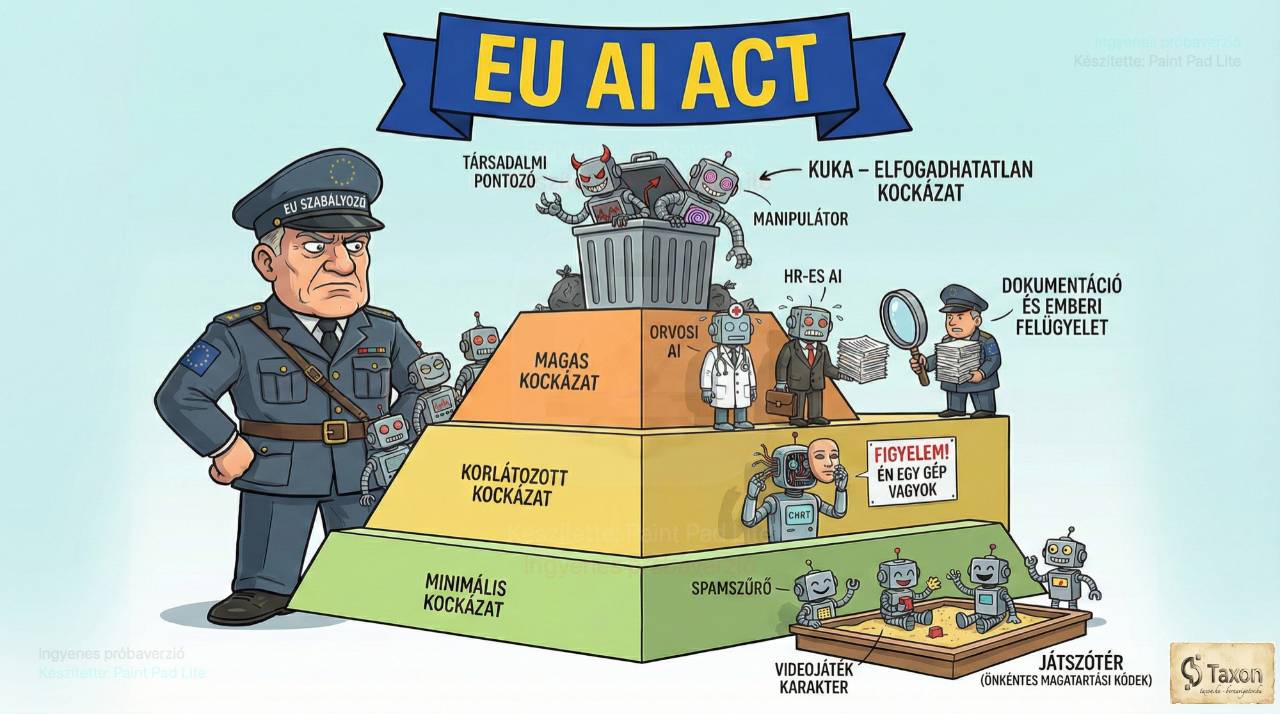

Az Európai Parlament és a Tanács mesterséges intelligenciáról szóló rendelete (a mesterséges intelligenciáról szóló rendelet, AI‑rendelet / AI Act) általános, technológiasemleges szabályokat állapít meg az MI ‑ rendszerekre, de több ponton kifejezetten érinti a munkaviszonyt és a HR ‑ folyamatokat.

Az AI ‑ rendelet és a munkajog viszonya

Az AI‑rendelet kifejezetten rögzíti, hogy nem érinti:

- az uniós szociálpolitikai jogot, és

- az uniós jognak megfelelő, foglalkoztatási és munkafeltételekre vonatkozó nemzeti munkajogot, beleértve a munkavédelmi szabályokat és a munkáltató – munkavállaló viszonyra vonatkozó normákat.

Ez a gyakorlatban azt jelenti, hogy:

- a munkaviszony tartalmát, a foglalkoztatás feltételeit továbbra is elsősorban a nemzeti munkajog (pl. Magyarországon a Munka Törvénykönyve) rendezi;

- az AI‑rendelet erre ráépülő, kiegészítő technikai‑jogi keretet ad az MI használatára, különösen ott, ahol az MI közvetlenül hat a munkavállalókra.

Munkával kapcsolatos MI ‑ rendszerek, mint „nagy kockázatú” rendszerek

Az AI ‑ rendelet nagy kockázatú MI ‑ rendszereket sorol fel. Ezek között önálló csoportként szerepel a „foglalkoztatás, a munkavállalók irányítása és az önfoglalkoztatáshoz való hozzáférés” területe.

A rendelet szövege alapján nagy kockázatú az a MI ‑ rendszer, amelyet többek között az alábbi célokra szánnak:

- Felvétel, kiválasztás

- jelöltek toborzása, célzott álláshirdetések megjelenítése;

- jelentkezések elemzése, előszűrése;

- jelöltek alkalmasságának, rangsorának értékelése.

- Munkaviszony feltételei, irányítás

- a munkafeltételek (pl. beosztás, munkarend, bizonyos szerződéses feltételek) meghatározása;

- előléptetési döntések támogatása;

- a munkaviszony megszüntetésére irányuló döntést támogató rendszerek;

- olyan feladatkiosztás, amely egyéni magatartáson, személyes jellemzőkön vagy tulajdonságokon alapul;

- a munkavállalók teljesítményének és magatartásának nyomonkövetése és értékelése.

Ha egy munkáltató vagy más szervezet MI ‑ rendszert ilyen célokra alkalmaz, az a rendelet alapján nagy kockázatú MI‑rendszernek minősül, és az ehhez kapcsolódó szigorúbb követelmények vonatkoznak rá.

Kötelezettségek a munkáltató (mint „felhasználó”) számára

A rendelet külön foglalkozik azokkal, akik a nagy kockázatú MI ‑ rendszereket alkalmazzák (üzemeltetők, köztük a munkáltatók). A rendelet alapján a legfontosabb, munkaviszonyhoz kapcsolódó kötelezettségek:

Tájékoztatási kötelezettség a dolgozó felé

A nagy kockázatú MI ‑ rendszerek alkalmazói kritikus szerepet játszanak az érintett természetes személyek – így a munkavállalók – tájékoztatásában. A rendelet előírja, hogy:

- a munkáltatónak tájékoztatnia kell a munkavállalót arról, hogy az ő esetében nagy kockázatú MI ‑ rendszert használnak;

- a tájékoztatásnak ki kell térnie a rendszer rendeltetésére (mire használják, például kiválasztásra, teljesítményértékelésre, munkaidő‑tervezésre stb.);

- meg kell jelölni, milyen típusú döntésekhez használják a rendszert (pl. kiválasztás, előléptetés, felmondás előkészítése);

- a munkáltatónak tájékoztatást kell adnia a dolgozó magyarazathoz való jogáról is, vagyis arról, hogy a rendelet a nagy kockázatú MI ‑ rendszerek esetében jogot biztosít bizonyos mértékű magyarázatra a döntések vonatkozásában.

A bevezetés és működtetés során a rendelet összhangba hozza ezt az uniós és nemzeti szabályokkal, amelyek a munkavállalók tájékoztatásához, illetve konzultációhoz való jogát rögzítik.

Alapjog‑ és hatásvizsgálat

A nagy kockázatú MI - rendszerek bevezetése előtt az alkalmazónak hatásvizsgálatot kell végeznie, különösen az alapvető jogok szempontjából. A rendelet értelmében legalább a következőket kell tartalmaznia:

- azonosítani kell, hogy az alkalmazó mely folyamataiban fogja a rendszert a rendeltetésének megfelelően használni (például: toborzás, teljesítményértékelés, műszaktervezés, fegyelmi döntéseket előkészítő elemzések stb.);

- le kell írni, milyen időtartamban és milyen gyakorisággal fogják a rendszert használni;

- be kell mutatni, mely természetes személyek és csoportok tartoznak az érintettek körébe (pl. jelöltek, próbaidős munkavállalók, hosszabb ideje foglalkoztatottak, egyes műszakcsoportok stb.).

A hatásvizsgálatot:

- a bevezetést megelőzően kell elvégezni, és

- frissíteni kell, ha a releváns körülmények (pl. a rendszer használatának módja, érintettek köre) jelentősen megváltoznak.

A rendelet emellett a rendszerszintű kockázatok azonosítását és enyhítését írja elő – ez különösen a diszkrimináció, az átláthatóság hiánya, a túlzott megfigyelés vagy a munkavállalói jogok sérelmének kockázatait érinti.

Emberi felügyelet és nyomonkövethetőség

A rendelet kifejezetten utal arra, hogy a nagy kockázatú MI ‑ rendszerek esetében:

- emberi felügyeletet kell biztosítani;

- az alkalmazónak gondoskodnia kell arról, hogy a rendszer működése és döntései nyomon követhetők legyenek.

A munkaviszony szempontjából ez azt jelenti, hogy például:

- egy toborzási vagy teljesítményértékelő MI ‑ rendszer kimenetei nem lehetnek teljesen automatikus, „fekete doboz” döntések;

- a döntésben részt kell vennie olyan, megfelelő tudással rendelkező természetes személynek, aki képes érdemben felülvizsgálni, szükség esetén korrigálni az MI ‑ rendszer kimenetét.

Munkavállalói jogok és garanciák az AI ‑ rendelet alapján

A fentiek alapján a munkaviszonyban alkalmazott nagy kockázatú MI ‑ rendszerekhez több munkavállalói garancia kapcsolódik:

- Tájékoztatáshoz való jog - A munkavállaló jogosult tudni, hogy egy rá vonatkozó döntés vagy eljárás során nagy kockázatú MI‑rendszert használnak, milyen célból és milyen döntéstípusokra.

- Magyarázathoz való jog - A rendelet a nagy kockázatú rendszerek esetében előírja, hogy a természetes személyeket tájékoztatni kell a magyarázathoz való jogukról. Ez azt a célt szolgálja, hogy az érintett megértse, milyen módon játszott szerepet a MI‑rendszer az őt érintő döntésben.

- Védelem a tiltott MI‑gyakorlatokkal szemben - A rendelet – általános jelleggel – tilt bizonyos MI ‑ alkalmazásokat, többek között olyanokat, amelyek:

- személyek vagy csoportok általános értékelésére, „besorolására” szolgálnak,

- társadalmi viselkedésre vagy személyes tulajdonságokra építve, diszkriminatív, hátrányos megkülönböztetést eredményezhetnek.

Ezek a tilalmak a munka világában is irányadóak, tehát például a tisztán „szociális pontszámokra” épülő, általános „alkalmazotti érték” kiszámítása és ilyen pontszám alapján hátrányos döntések meghozatala kifejezetten problémás lehet.

4. Jog a meglévő munkajogi védelmekhez - Mivel az AI ‑ rendelet kifejezetten nem érinti a nemzeti munkajogot, a munkavállalókra a már meglévő munkajogi garanciák (pl. diszkrimináció tilalma, munkavédelmi kötelezettségek, tájékoztatási és konzultációs jogok) továbbra is alkalmazandók. Az MI ‑ rendszereknek ezekkel együtt kell megfelelniük.

Összefoglaló üzenetek a munkaviszony szempontjából

Az AI‑rendelet‑szöveg alapján a munkaviszonyra vonatkozó lényeg a következőképpen foglalható össze:

- A foglalkoztatással, munkavállalók irányításával és az önfoglalkoztatáshoz való hozzáféréssel kapcsolatos MI ‑ rendszerek alapvetően nagy kockázatú rendszereknek minősülnek.

- Ezeket csak szigorú feltételekkel lehet használni, amelyek közül a munkaviszony szempontjából kulcsfontosságú:

- a munkavállalók és jelöltek tájékoztatása a rendszer használatáról, céljáról és a döntések típusáról;

- a magyarázathoz való jogról való tájékoztatás;

- előzetes és folyamatos hatásvizsgálat a munkafolyamatokra és az érintett személyekre gyakorolt hatásról;

- emberi felügyelet és nyomonkövethetőség biztosítása a rendszerek működése felett;

- a tiltott MI‑gyakorlatok (különösen a diszkriminatív „szociális pontozás” jellegű alkalmazások) elkerülése.

- Az AI‑rendelet nem váltja ki a nemzeti munkajogot, hanem ahhoz képest további technikai‑jogi követelményeket állapít meg a munkaviszonyban használt MI‑rendszerekre.

Mikortól lép hatályba?

A mesterséges intelligenciáról szóló uniós rendelet (AI‑rendelet / AI Act) nem tartalmazza a formális „hatálybalépés” (belépés az uniós jogrendbe) pontos cikkét, viszont egyértelműen rögzíti, mikor kell alkalmazni a szabályait:

A rendelet preambuluma szerint (179. pont):

- Általános alkalmazás:

- „Ezt a rendeletet 2026. augusztus 2-től kell alkalmazni.”

- Tiltott MI ‑ gyakorlatok és általános rendelkezések:

- már 2025. február 2-től alkalmazandók.

- Irányítási és megfelelőségi struktúra (bejelentett szervezetek, governance), általános célú MI‑modellekre vonatkozó kötelezettségek, szankciók:

- 2025. augusztus 2-től alkalmazandók.

A rendelkezésre álló szöveg alapján tehát a gyakorlatban:

- a tiltott MI ‑ használati formák és az alapvető általános szabályok 2025.02.02‑től,

- az AI ‑ rendelet teljes rendszere és a nagy kockázatú / HR ‑ célú MI ‑ rendszerekre vonatkozó kötelezettségek 2026.08.02‑től kötelezően alkalmazandók.

Hatékonyság kontra Jogi Kockázatok

A mesterséges intelligencia alkalmazása a bérszámfejtésben és a HR-ben kétélű fegyver. Szakmai véleményem szerint az MI kiváló szolga, de veszélyes úr.

1. Bérszámfejtés és TB-ügyintézés

Az MI legnagyobb előnye itt az anomáliák szűrése. A modern bérprogramokba integrált modulok képesek valós időben jelezni, ha egy számfejtés eltér a szokásostól (pl. irreálisan magas túlóra, hiányzó jelenléti adat, inkonzisztens családi kedvezmény érvényesítés). Ez csökkenti az emberi hiba lehetőségét, és minimalizálja a NAV - ellenőrzések kockázatát.

A kockázat: A „fekete doboz” effektus. Ha a bérszámfejtő vakon elfogadja a gép által kalkulált eredményt anélkül, hogy értené a mögöttes jogszabályi logikát (pl. a TB-járulék alapjának speciális szabályait), az végzetes hibákhoz vezethet. A felelősség ugyanis jogilag nem a szoftverfejlesztőé, hanem a munkáltatóé.

2. Toborzás és kiválasztás (Recruitment)

Az ATS (Applicant Tracking System) rendszerek ma már rutinszerűen rangsorolják az önéletrajzokat. Ez gyorsítja a folyamatot, de itt ütközünk a legnagyobb jogi falba: a diszkrimináció tilalmába. Ha az algoritmust olyan múltbeli adatokon tanították, ahol például férfiakat preferáltak vezetői pozícióban, az MI reprodukálni fogja ezt az előítéletet, megsértve az egyenlő bánásmód követelményét.

3. Munkajogi megfelelés és GDPR

Az EU AI Act és a GDPR 22. cikke (automatizált döntéshozatal) értelmében a munkavállalóknak joguk van tudni arról, ha döntéseket (pl. bónusz megítélése, előléptetés) algoritmusok támogatnak. Az átláthatóság hiánya nemcsak bizalomvesztést, hanem az Alapvető Jogok Biztosának vizsgálatát és súlyos bírságokat is vonhat maga után.

Gyakorlati példák: A jó, a rossz és a veszélyes

- Pozitív példa (Adminisztráció): Egy nagyvállalat belső chatbotot vezet be, amely 24/7 válaszol a munkavállalók standard kérdéseire (pl. „Mennyi szabadságom maradt?”, „Hogyan igényelhetem a családi adókedvezményt?”). Ez tehermentesíti a HR -osztályt, a válaszok pedig a hatályos jogszabályok alapján, zárt és ellenőrzött adatbázisból érkeznek.

- Negatív példa (Diszkrimináció): Egy cég olyan MI - t használ az előszűrésre, amely automatikusan hátrébb sorolja azokat a jelentkezőket, akiknek az önéletrajzában 2 évnél hosszabb kihagyás szerepel (pl. CSED/GYED miatt). Ez közvetett hátrányos megkülönböztetésnek minősül a kisgyermekes szülőkkel szemben, ami munkaügyi perben védhetetlen.

- Veszélyes példa (Adatvédelem): A bérszámfejtési adatokat egy nyilvános, felhőalapú MI - modellbe (pl. ChatGPT publikus verziója) töltik fel elemzésre, anélkül, hogy az adatokat anonimizálnák. Ez súlyos GDPR-incidens, mivel különleges személyes adatok (pl. betegségek miatti táppénz kódok, szakszervezeti tagdíj, letiltások) kerülhetnek ki a szervezet kontrollja alól, és válhatnak a modell tanító adatbázisának részévé.

Gyakori hibák, amiket el kell kerülni

Szakértői praxisomban az alábbi típushibákkal találkozom leggyakrabban:

- A „Human-in-the-loop” elv figyelmen kívül hagyása: Sosem szabad hagyni, hogy egy algoritmus automatikusan hozzon joghatással járó döntést (pl. munkaviszony megszüntetése, fegyelmi eljárás indítása) érdemi emberi felülvizsgálat nélkül.

- Tájékoztatás elmulasztása: A munkavállalót nem tájékoztatják arról, hogy a teljesítményét MI figyeli vagy értékeli. Ez sérti az Mt. adatkezelési alapelveit és a GDPR átláthatósági követelményét.

- Túlzott adatgyűjtés (Célhoz kötöttség elve): Csak azért gyűjteni adatokat (pl. billentyűleütések száma, egérmozgás, képernyőfotók), mert a technológia lehetővé teszi, jogsértő. Az adatkezelésnek mindig célhoz kötöttnek és arányosnak kell lennie; a szükségtelen megfigyelés jogellenes.

Összegzés

2026-ban a mesterséges intelligencia a bérszámfejtésben és a HR - ben nem helyettesíti a szakembert, hanem felértékeli a tudását. Az adminisztratív „favágást” a gépek végzik, de a jogi értelmezés, az etikai mérlegelés és a komplex problémamegoldás tisztán emberi feladat marad.

Használjuk bátran az MI-t az adatok tisztítására, riportok készítésére és anomáliák keresésére, de a döntéshozatalt soha ne engedjük ki a kezünkből. A NAV és a bíróság előtt nem az algoritmus, hanem a munkáltató fog állni.

Barabás Miklós